En 2025, les arnaques dopées à l’IA explosent et la France n’est pas épargnée

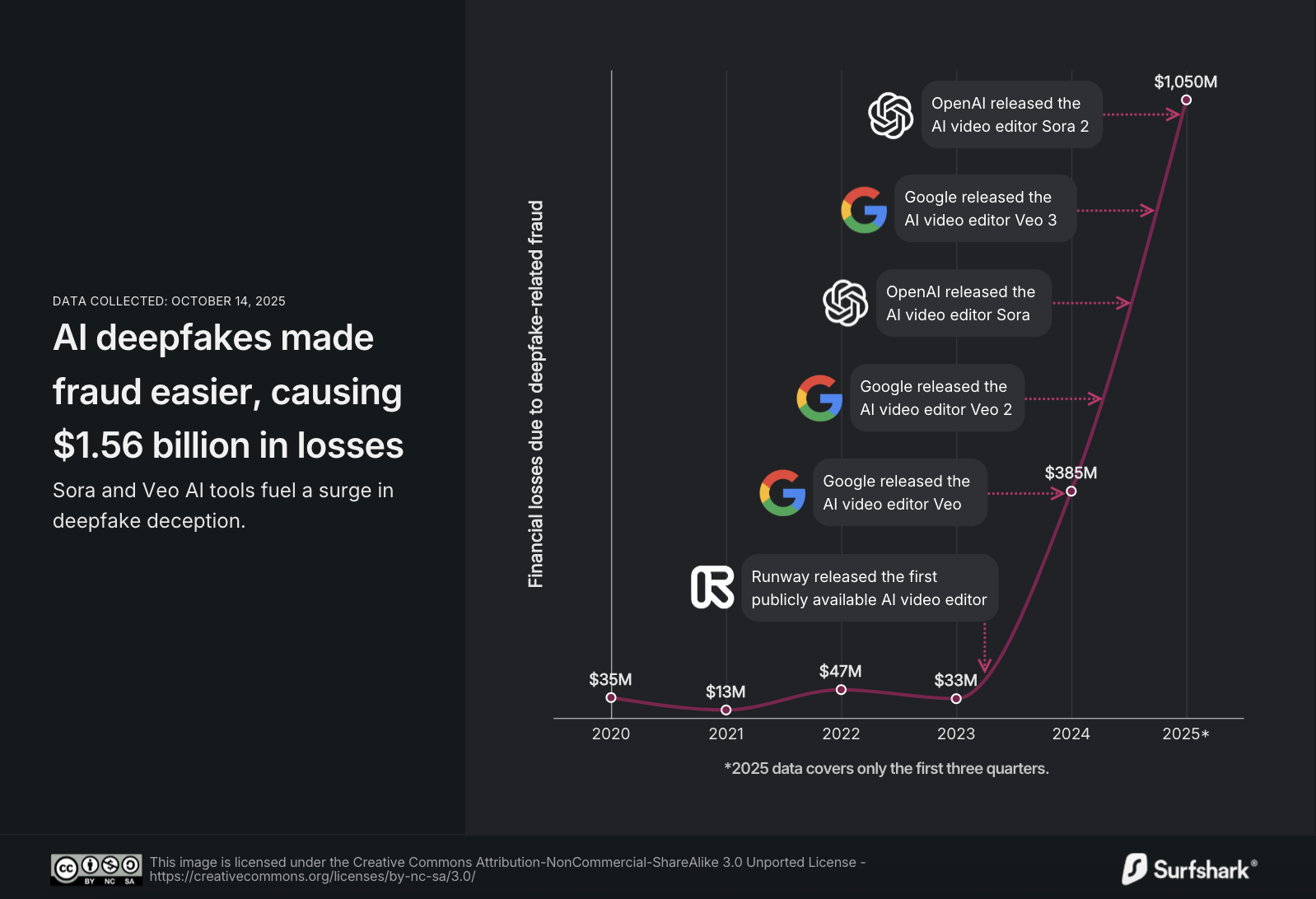

Paris, le 23 octobre 2025 – Les escroqueries reposant sur les deepfakes (images, voix ou vidéos générées par intelligence artificielle) atteignent un niveau alarmant : selon la dernière étude mondiale de Surfshark, les pertes financières liées à ces fraudes dépassent désormais 1,56 milliard $, soit près de 1,34 milliard €. Rien qu’en 2025, plus d’un milliard de dollars (environ 860 millions €) se sont volatilisés à cause de ces manipulations numériques.

Une escalade fulgurante

-

2019-2023 : 130 millions $ de pertes cumulées.

-

2024 : 400 millions $.

-

2025 : déjà 1 milliard $.

En six ans, les pertes ont été multipliées par 12.

Jusqu’à récemment, produire une vidéo deepfake d’une minute coûtait entre 300 et 20 000 $ selon la qualité. Aujourd’hui, grâce à des outils d’IA grand public comme Sora ou Veo, le même contenu peut être généré pour quelques euros. Résultat : les escroqueries deviennent plus simples, plus rapides et infiniment plus rentables.

De la finance aux “faux animaux perdus” : des escroqueries à tous les étages

Les deepfakes ne se limitent plus aux arnaques d’investissement sophistiquées. De nouveaux scénarios émotionnels émergent :

-

des images générées de chiens ou chats perdus, envoyées à des propriétaires paniqués, avec une demande de 50 € de “frais de restitution” ;

-

des vidéos truquées d’employés ou de dirigeants demandant un virement urgent ;

-

ou encore des entretiens d’embauche falsifiés, où un cybercriminel simule une identité complète à l’écran.

« Le coût de la tromperie est désormais proche de zéro », alerte Maud Fraison Lepetit, Responsable France chez Surfshark.« Ce n’est plus une fraude isolée, c’est une industrialisation de la manipulation. »

Maud se tient à votre disposition pour répondre à des interviews et approfondir cette nouvelle étude .

Comment se protéger

Surfshark recommande à chacun – particuliers, entreprises et institutions – de renforcer son scepticisme numérique :

-

Vérifier systématiquement toute demande d’argent ou d’information par un canal connu (appel direct, confirmation interne).

-

Prendre son temps : la précipitation est l’arme favorite des escrocs.

-

Former les équipes sensibles (finance, RH, communication) à reconnaître les signaux d’un deepfake (voix trop “parfaite”, micro-décalage des lèvres, incohérences visuelles).

-

Renforcer les procédures multi-niveaux avant toute transaction ou embauche.

Une fracture numérique nouvelle génération

Alors que l’IA bouleverse déjà les métiers, la culture et la création, elle transforme désormais la criminalité.

Les deepfakes ne sont plus de simples curiosités virales : ils deviennent un outil économique de fraude de masse .

Cette mutation impose une réponse rapide : formation, régulation, coopération entre plateformes et institutions.

Les deepfakes ne sont plus de simples curiosités virales : ils deviennent un outil économique de fraude de masse .

Cette mutation impose une réponse rapide : formation, régulation, coopération entre plateformes et institutions.

Étude complète : Surfshark Research – “AI Deepfake Losses”